- Main

- Computers - Computer Science

- Strengthening Deep Neural Networks:...

Strengthening Deep Neural Networks: Making AI Less Susceptible to Adversarial Trickery

Katy WarrJak bardzo podobała Ci się ta książka?

Jaka jest jakość pobranego pliku?

Pobierz książkę, aby ocenić jej jakość

Jaka jest jakość pobranych plików?

As deep neural networks (DNNs) become increasingly common in real-world applications, the potential to deliberately "fool" them with data that wouldn’t trick a human presents a new attack vector. This practical book examines real-world scenarios where DNNs—the algorithms intrinsic to much of AI—are used daily to process image, audio, and video data.

Author Katy Warr considers attack motivations, the risks posed by this adversarial input, and methods for increasing AI robustness to these attacks. If you’re a data scientist developing DNN algorithms, a security architect interested in how to make AI systems more resilient to attack, or someone fascinated by the differences between artificial and biological perception, this book is for you.

• Delve into DNNs and discover how they could be tricked by adversarial input

• Investigate methods used to generate adversarial input capable of fooling DNNs

• Explore real-world scenarios and model the adversarial threat

• Evaluate neural network robustness; learn methods to increase resilience of AI systems to adversarial data

• Examine some ways in which AI might become better at mimicking human perception in years to come

Author Katy Warr considers attack motivations, the risks posed by this adversarial input, and methods for increasing AI robustness to these attacks. If you’re a data scientist developing DNN algorithms, a security architect interested in how to make AI systems more resilient to attack, or someone fascinated by the differences between artificial and biological perception, this book is for you.

• Delve into DNNs and discover how they could be tricked by adversarial input

• Investigate methods used to generate adversarial input capable of fooling DNNs

• Explore real-world scenarios and model the adversarial threat

• Evaluate neural network robustness; learn methods to increase resilience of AI systems to adversarial data

• Examine some ways in which AI might become better at mimicking human perception in years to come

Kategorie:

Rok:

2019

Wydanie:

1

Wydawnictwo:

O’Reilly Media

Język:

english

Strony:

246

ISBN 10:

1492044954

ISBN 13:

9781492044956

Plik:

PDF, 32.55 MB

Twoje tagi:

IPFS:

CID , CID Blake2b

english, 2019

Czytaj Online

- Ściągnij

- pdf 32.55 MB Current page

- Checking other formats...

- Konwertuj w

- Odblokuj konwersję plików większych niż 8 MBPremium

Chcesz dodać księgarnię? Skontaktuj się z nami na support@z-lib.do

Plik zostanie dostarczony na Twój e-mail w ciągu 1-5 minut.

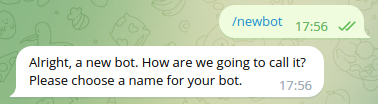

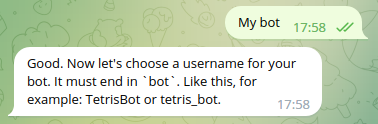

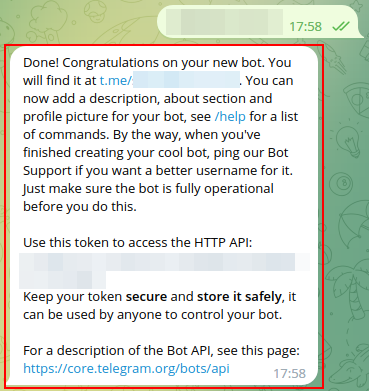

W ciągu 1-5 minut plik zostanie dostarczony na Twoje konto Telegram.

Uwaga: Upewnij się, że połączyłeś swoje konto z botem Z-Library Telegram.

W ciągu 1-5 minut plik zostanie dostarczony na Twoje urządzenie Kindle.

Uwaga: musisz zweryfikować każdą książkę, którą chcesz wysłać na swój Kindle. Sprawdź swoją skrzynkę pocztową pod kątem e-maila weryfikacyjnego z Amazon Kindle Support.

Trwa konwersja do

Konwersja do nie powiodła się

Korzyści ze statusu premium

- Wyślij do e-czytników

- Zwiększony limit pobierania

Konwertuj pliki

Konwertuj pliki Więcej wyników wyszukiwania

Więcej wyników wyszukiwania Inne korzyści

Inne korzyści

Najbardziej popularne frazy

Powiązane listy książek

Amazon

Amazon  Barnes & Noble

Barnes & Noble  Bookshop.org

Bookshop.org